四川在線記者 寧寧

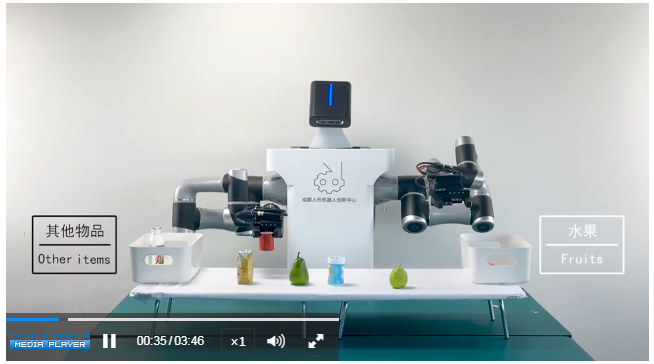

8月12日,記者從成都人形機器人創新中心獲悉,該中心發布了最新研發成果——機器人多模態模型RRMM(Raydiculous RobotMultimodal Model)及雙臂協作系統RTACS(Raydiculous Two-Arm Cooperation System),該模型能使機器人理解推理抽象的語義指令,并調度雙臂協作系統執行任務。

由于此前僅有OpenAI等國外人工智能頭部企業發布了類似成果,此次發布也標志著成都在我國多模態模型應用于人形機器人領域取得率先突破,進一步加速了“AI物理化”進程,也讓人形機器人從“預設擺拍”、“遙控操作”進化到擁有更強的“大腦”和自主執行能力。

多模態數據協同推理,即能融合兩種或兩種以上不同感知來源,進行綜合推理,并完成復雜任務。譬如,最新的ChatGPT4o在展示其強大功能時,測試者不用傳統的鍵盤輸入問題指令,而是在一張紙上手寫一個待解方程以及手繪一個幾何圖形,并用語音指令要求GPT4o解題,GPT4o通過圖像識別、語音識別和語義理解及推理,快速給出準確答案。

“這就是典型的多模態應用。”成都人形機器人創新中心相關負責人介紹,它主要應用于人形機器人領域,使人形機器人能融合圖像、語義、力感知、環境感知等多種因素,綜合判斷、生成任務并執行任務,是讓人形機器人具有自主思考能力的關鍵核心技術。

語義指令,涉及將對象進行相對明確和相對抽象地區分和分揀,完成這些任務則需要機器人通過多模態模型自主對所有物品進行提取歸納。“比如,在對瓶子形狀的物體進行可食用和不可食用區分、分揀時,需要通過進一步對瓶身包裝上的文字、圖片等要素進行綜合判斷,才能區分其為可食用還是非食用瓶裝物。”成都人形機器人創新中心相關負責人說。

成都人形機器人創新中心是我國中西部地區首個人形機器人創新中心,是四川省人工智能一號創新工程的首個原點項目,致力于研發“真正擁有大腦的人形機器人整機”的人形機器人。

(視頻由成都人形機器人創新中心提供)

編輯:譚鵬